本地运行大模型的6种方法

llm

商业AI和大型语言模型(LLMs)有一个很大的缺点:隐私!在处理敏感或专有数据时,我们无法从这些工具中受益。 这就引出了我们需要了解如何在本地操作私有LLM。开源模型提供了一种解决方案,但它们也带来了自己的一系列挑战和优势。 请加入我的探索,寻找一个可以在你自己的电脑上运行的ChatGPT本地替代方案。

设定期望值

开源领域非常广阔,有成千上万的模型可供使用,从像Meta这样的大型组织提供的模型到个人爱好者开发的模型。然而,运行这些模型本身也存在一系列挑战:

- 可能需要强大的硬件:大量的内存和可能需要GPU。

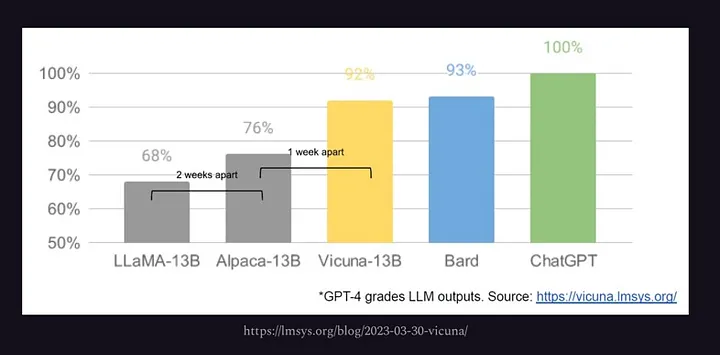

- 虽然开源模型在不断改进,但通常无法与经过大量工程师支持的更完善的产品(如ChatGPT)相媲美。

- 并非所有模型都可以用于商业用途。

- 开源和闭源模型之间的差距正在缩小,正如Google泄露的文件所暗示的那样。

1. Hugging Face 和 Transformers

HuggingFace是机器学习和人工智能领域的Docker Hub,提供了海量的开源模型。幸运的是,HuggingFace会定期对模型进行基准测试,并提供排行榜来帮助选择最佳模型。 HuggingFace还提供了Transformers,这是一个Python库,可以简化本地运行大型语言模型。 以下示例使用该库运行较早的 GPT-2 模型 microsoft/DialoGPT-medium。 在第一次运行时,Transformers 会下载模型,你可以与之进行五次互动。该脚本还需要安装 PyTorch。

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

tokenizer = AutoTokenizer.from_pretrained("microsoft/DialoGPT-medium", padding_side='left')

model = AutoModelForCausalLM.from_pretrained("microsoft/DialoGPT-medium")

# source: https://huggingface.co/microsoft/DialoGPT-medium

# Let's chat for 5 lines

for step in range(5):

# encode the new user input, add the eos_token and return a tensor in Pytorch

new_user_input_ids = tokenizer.encode(input(">> User:") + tokenizer.eos_token, return_tensors='pt')

# append the new user input tokens to the chat history

bot_input_ids = torch.cat([chat_history_ids, new_user_input_ids], dim=-1) if step > 0 else new_user_input_ids

# generated a response while limiting the total chat history to 1000 tokens,

chat_history_ids = model.generate(bot_input_ids, max_length=1000, pad_token_id=tokenizer.eos_token_id)

# pretty print last output tokens from bot

print("DialoGPT: {}".format(tokenizer.decode(chat_history_ids[:, bot_input_ids.shape[-1]:][0], skip_special_tokens=True)))Transformers 优点:

- 自动下载模型

- 提供代码示例

- 适合实验和学习

Transformers 缺点:

- 需要对机器学习和自然语言处理有扎实的理解

- 需要编写代码和进行配置

2. LangChain

另一种本地运行大型语言模型的方法是使用LangChain。LangChain是一个用于构建AI应用的Python框架。 它提供抽象和中间件,以便在其支持的模型之上开发AI应用。例如,以下代码向 microsoft/DialoGPT-medium 模型提出了一个问题:

from langchain.llms.huggingface_pipeline import HuggingFacePipeline

hf = HuggingFacePipeline.from_model_id(

model_id="microsoft/DialoGPT-medium", task="text-generation", pipeline_kwargs={"max_new_tokens": 200, "pad_token_id": 50256},

)

from langchain.prompts import PromptTemplate

template = """Question: {question}

Answer: Let's think step by step."""

prompt = PromptTemplate.from_template(template)

chain = prompt | hf

question = "What is electroencephalography?"

print(chain.invoke({"question": question}))LangChain 优点:

- 更容易管理模型

- 提供有用的工具用于AI应用开发

LangChain 缺点:

- 速度有限,与Transformers相同

- 仍需编写应用逻辑或创建合适的用户界面

3. Llama.cpp

Llama.cpp是一个基于C和C++的推理引擎,专为Apple硅优化并运行Meta的Llama2模型。 克隆仓库并构建项目后,我们可以运行一个模型:

$ ./main -m /path/to/model-file.gguf -p "Hi there!"Llama.cpp 优点:

- 性能高于基于Python的解决方案

- 支持在较低配置的硬件上运行大模型,如Llama 7B

- 提供绑定以用其他语言构建AI应用,同时通过Llama.cpp进行推理

Llama.cpp 缺点:

- 模型支持有限

- 需要构建工具

4. Llamafile

Llamafile是Mozilla开发的一个友好替代方案,用于运行大型语言模型。Llamafile以其便携性和创建单文件可执行文件的能力而闻名。 下载llamafile和任何GGUF格式的模型后,我们可以启动一个本地浏览器会话:

$ ./llamafile -m /path/to/model.ggufLlamafile 优点:

- 与Llama.cpp相同的速度优势

- 你可以构建嵌入模型的单个可执行文件

Llamafile 缺点:

- 项目仍处于早期阶段

- 仅支持Llama.cpp支持的模型

5. Ollama

Ollama是一个比Llama.cpp和Llamafile更用户友好的替代方案。你下载一个可执行文件,该文件在你的机器上安装一个服务。安装后,打开终端并运行:

$ ollama run llama2Ollama将下载模型并启动一个交互式会话。

Ollama 优点:

- 易于安装和使用

- 可以运行llama和vicuña模型

- 速度非常快

Ollama 缺点:

- 提供有限的模型库

- 自行管理模型,无法重用自己的模型

- 无法调整运行选项

- 暂无Windows版本

6. GPT4ALL

GPT4ALL是一个易于使用的桌面应用,具有直观的图形用户界面。它支持本地模型运行,并通过API密钥连接到OpenAI。它以其处理本地文档以获取上下文的能力而著称,确保隐私。

优点:

- 友好的用户界面

- 支持一系列精心挑选的模型

缺点:

- 模型选择有限

- 某些模型有商业使用限制

结论

选择在本地运行大型语言模型的工具取决于你的需求和专业知识。从用户友好的应用(如GPT4ALL)到更技术性的选项(如Llama.cpp和基于Python的解决方案), 这个领域提供了各种选择。开源模型正在迎头赶上,提供了更多的数据和隐私控制。 本指南旨在为你导航本地大型语言模型的世界提供清晰的指引。随着这些模型的发展,它们有望变得更具竞争力,与ChatGPT等产品相抗衡。

本文翻译自以下网页 https://medium.com/@semaphoreci/6-ways-to-run-llms-locally-fa25be0797e5